В то время как первые системы на базе готовящегося к выпуску процессора Intel Meteor Lake (14й Gen Core) все еще по крайней мере несколько месяцев — и, таким образом, слишком далеко, чтобы хвастаться на Computex — Intel уже закладывает основу для предстоящего запуска Meteor Lake. На выставке этого года, которая очень быстро превратилась в мероприятие, ориентированное на ИИ, Intel использует Computex, чтобы изложить свое видение вывода ИИ на стороне клиента для систем следующего поколения. Это включает в себя как некоторые новые раскрытия информации об оборудовании для обработки ИИ, которое будет в оборудовании Intel Meteor Lake, так и то, что Intel ожидает от разработчиков ОС и программного обеспечения, которые собираются делать с новыми возможностями.

ИИ, конечно, быстро стал модным словом в технологической индустрии за последние несколько месяцев, особенно после публичного представления ChatGPT и взрыва интереса к тому, что сейчас называют «генеративным ИИ». Таким образом, как и на ранних стадиях внедрения других крупных новых вычислительных технологий, поставщики аппаратного и программного обеспечения все еще находятся в процессе выяснения того, что можно сделать с этой новой технологией, и каковы наилучшие аппаратные конструкции для ее обеспечения. И за всем этим… давайте просто скажем, что у тех компаний, которые преуспеют в этой новой гонке ИИ, есть большой потенциальный доход, ожидающий своего часа.

Intel, со своей стороны, не новичок в аппаратном обеспечении ИИ, хотя это, безусловно, не та область, которая обычно получает самые высокие счета в компании, наиболее известной своими процессорами и фабриками (и именно в таком порядке). Среди стопроцентных дочерних компаний Intel в этой сфере — Movidius, производящая маломощные процессоры машинного зрения (VPU), и Habana Labs, отвечающая за семейство высокопроизводительных ускорителей глубокого обучения Gaudi. Но даже в рядовых клиентских продуктах Intel компания включает очень простое оборудование со сверхнизким энергопотреблением, связанное с искусственным интеллектом, в виде блока Gaussian & Neural Accelerator (GNA) для обработки звука, который был в семействе Core начиная с архитектуры Ice Lake.

Тем не менее, в 2023 году ветер явно дует в сторону добавления еще большего количества аппаратного обеспечения ИИ на всех уровнях, от клиента до сервера. Итак, для Computex Intel раскрывает немного больше информации о своих усилиях в области искусственного интеллекта для Meteor Lake.

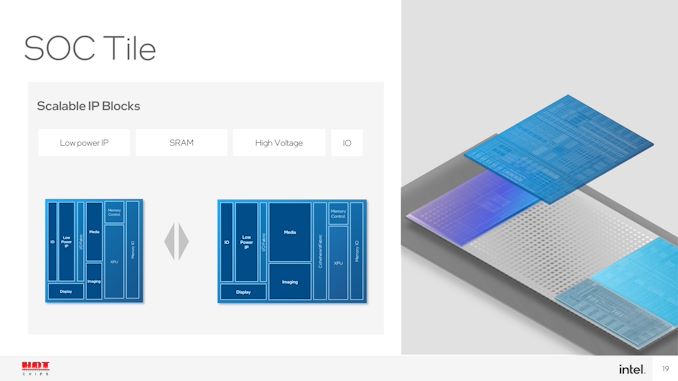

Meteor Lake: SoC Tile включает VPU на основе Movidius для вывода ИИ с низким энергопотреблением

Что касается аппаратного обеспечения, то большое раскрытие информации от Intel заключается в том, что, как мы уже давно подозревали, Intel внедряет более мощное оборудование для искусственного интеллекта в дезагрегированную SoC. Ранее задокументированный в некоторых презентациях Intel как блок «XPU» внутри плитки SoC Meteor Lake (средняя плитка), теперь Intel подтверждает, что этот XPU является полным блоком ускорения ИИ.

В частности, этот блок является производным от устройства обработки изображений третьего поколения Movidius (VPU), и в будущем Intel точно идентифицирует его как VPU.

Количество технических подробностей, которые Intel предлагает по блоку VPU для Computex, ограничено — у нас нет никаких показателей производительности или представления о том, сколько места на кристалле SoC он занимает. Но самый последний VPU Movidius, Myriad X, включал в себя довольно гибкий механизм нейронных вычислений, который отвечал за предоставление VPU возможностей нейронной сети. Двигатель Myriad X рассчитан на пропускную способность 1 TOPS, хотя спустя почти 6 лет и несколько технологических узлов Intel почти наверняка стремится к гораздо большему для Meteor Lake.

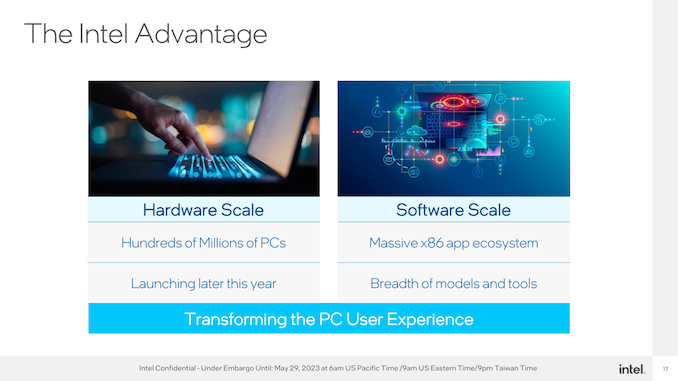

Поскольку это часть плитки SoC Meteor Lake, VPU будет присутствовать во всех SKU Meteor Lake. Intel не будет использовать его в качестве дифференциатора функций, например ECC или даже встроенной графики; так что это будет базовая функция, доступная для всех частей на базе Meteor Lake.

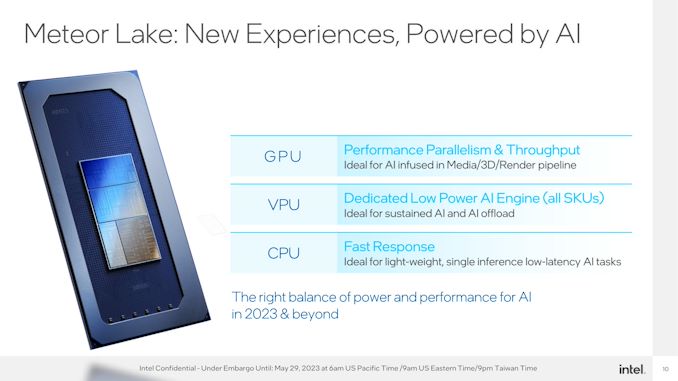

Цель VPU, в свою очередь, состоит в том, чтобы предоставить третий вариант рельса для обработки ИИ. Для высокопроизводительных нужд есть встроенный графический процессор, чей значительный массив ALU может обеспечить относительно большой объем обработки для матричных вычислений за нейронными сетями. Между тем ЦП останется предпочтительным процессором для простых рабочих нагрузок с малой задержкой, которые либо не могут позволить себе ждать инициализации VPU, либо когда размер рабочей нагрузки не оправдывает затраченных усилий. Это оставляет VPU посередине в качестве выделенного, но маломощного ускорителя искусственного интеллекта, который можно использовать для устойчивых рабочих нагрузок искусственного интеллекта, которым не требуется производительность (и энергопотребление) графического процессора.

Также стоит отметить, что, хотя это явно не указано в диаграммах Intel, блок GNA также останется для Meteor Lake. Его особенностью является работа со сверхнизким энергопотреблением, поэтому он по-прежнему необходим для таких вещей, как пробуждение по голосу и совместимость с существующим программным обеспечением с поддержкой GNA.

Помимо этого, мы еще многого не знаем о VPU Meteor Lake. Тот факт, что он даже называется VPU и включает в себя технологию Movidius, подразумевает, что это дизайн, ориентированный на компьютерное зрение, аналогичный дискретным VPU Movidius. Если это так, то визуальный процессор Meteor Lake может превосходно справляться с визуальными нагрузками, но ему не хватает производительности и гибкости в других областях. И хотя сегодняшнее раскрытие информации Intel быстро вызывает вопросы о том, как этот блок будет сравниваться по производительности и функциональности с блоком Ryzen AI от AMD, производным от Xilinx, эти вопросы придется подождать до другого дня.

По крайней мере, на данный момент Intel считает, что у них хорошие возможности для того, чтобы возглавить трансформацию ИИ в клиентском пространстве. И они хотят, чтобы мир — разработчики и пользователи — знали об этом.

Программная сторона: что делать с ИИ?

Как отмечалось во введении, аппаратное обеспечение — это только половина уравнения, когда речь идет об ускоренном программном обеспечении ИИ. Еще важнее, чем то, на чем его запускать, — это то, что с ним делать, и это то, над чем Intel и ее партнеры по программному обеспечению все еще работают.

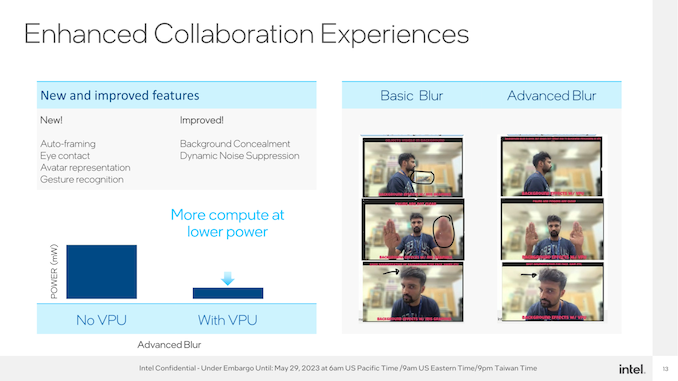

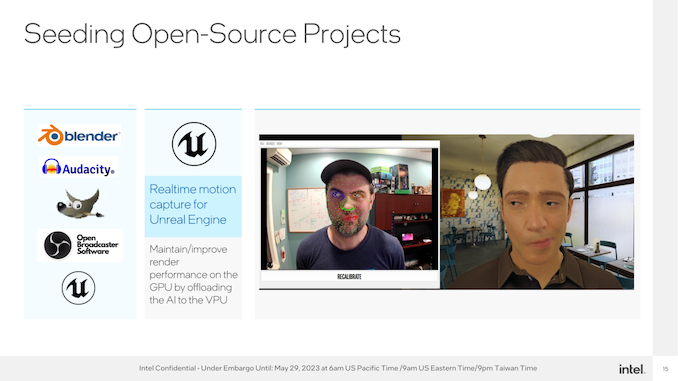

На самом базовом уровне включение VPU обеспечивает дополнительную энергоэффективную производительность для выполнения задач, которые уже в той или иной степени управляются искусственным интеллектом на некоторых платформах, таких как динамическое подавление шума и сегментация фона. В этом отношении включение VPU догоняет SoC класса смартфонов, где такие вещи, как Apple Neural Engine и Qualcomm Hexagon NPU, сегодня обеспечивают аналогичное ускорение.

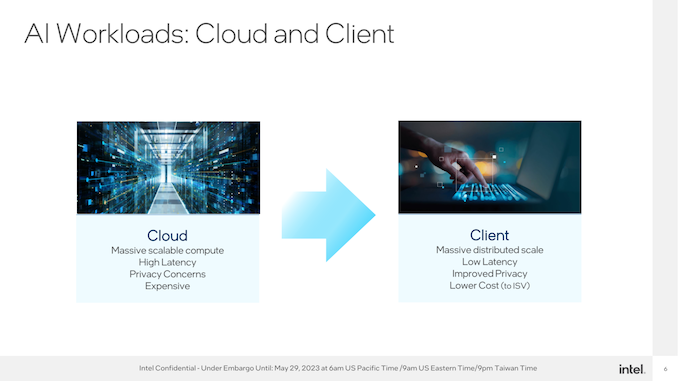

Но Intel присматривается к гораздо более крупному призу. Они оба хотят способствовать перемещению того, что в настоящее время является серверными рабочими нагрузками ИИ, на периферию — другими словами, перемещению обработки ИИ на клиент — а также развитию совершенно новых рабочих нагрузок ИИ.

Что это такое на данный момент, еще предстоит выяснить. Microsoft изложила некоторые из своих собственных идей на прошлой неделе на своей ежегодной конференции Build, включая объявление о функция второго пилота для Windows 11. И поставщик ОС также закладывает основу для разработчиков с помощью среды выполнения Open Neural Network Exchange (ONNX).

В какой-то степени весь технический мир находится в точке, где у него есть новый молоток, и теперь все начинает выглядеть очень похоже на гвоздь. Intel, со своей стороны, конечно, не отстранена от этого, так как даже сегодняшнее раскрытие информации скорее вдохновляет, чем говорит о конкретных преимуществах с точки зрения программного обеспечения. Но это действительно первые дни для ИИ, и никто не понимает, что можно, а что нельзя делать. Конечно, есть несколько гвоздей, которые можно забить.

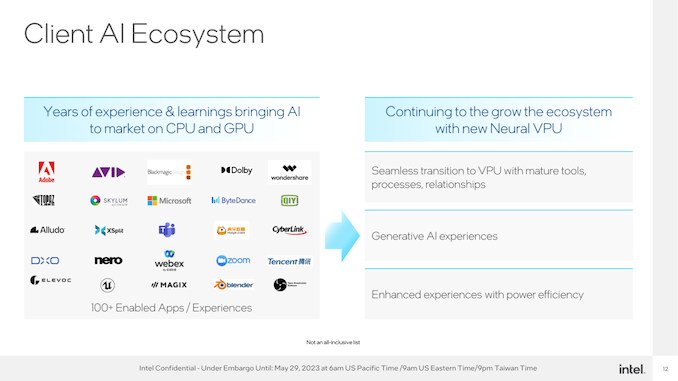

С этой целью Intel стремится развивать экосистему «создали, и они придут» для ИИ в пространстве ПК. Предоставляйте аппаратное обеспечение по всем направлениям, работайте с Microsoft над предоставлением программных инструментов и API-интерфейсов, необходимых для использования аппаратного обеспечения, и смотрите, какие новые возможности разработчики могут предложить — или, в качестве альтернативы, какие рабочие нагрузки они могут переложить на VPU для снижения энергопотребления. .

В конечном счете, Intel ожидает, что рабочие нагрузки на основе ИИ изменят работу пользователей ПК. И независимо от того, произойдет это полностью или нет, этого достаточно, чтобы гарантировать включение аппаратного обеспечения для этой задачи в их процессоры следующего поколения.

www.anandtech.com